这种「AI换脸」诈骗案,竟然骗走了2亿巨款

热搜大全 2024-02-07

从去年开始,有一个词儿开始频繁出现在我们的日常生活,它就是「AI」。

小伙伴们别不信,仔细想想日常的衣食住行,是不是多少都有点 AI 的身影了?

就拿小雷来说,看外语视频会用手机 AI 字幕,去哪玩有 AI 推荐地点和规划路线。

在外吃饭写评语直接用 AI 生成,网购买衣服可以用 AI 进行试穿瞅瞅效果怎么样。

可以这么说,AI 的出现能帮助我们做到更多的事儿,从而实现省时省力的效果。

图源:小雷手机截图

但是,小雷又要说但是了嚯。

AI 在带给我们工作生活便利的同时,也诞生了一系列围绕 AI 的投机或者犯罪行为。

这不昨天才曝光出来的热乎新闻,香港发生了一起当地史上最大的「AI 诈骗案」。

此案涉及金额高达 2 亿元港币(约合当前 1.84 亿元人民币),这可不是一笔小数目!

那么问题来了,骗子是怎么通过 AI 实施骗术的?这类骗术有没有什么破解办法呢?

据港媒报道,这起 AI 诈骗案发生在一所跨国公司,报案人为该公司的香港分公司的员工。

喏,这名员工在上个月收到了来自英国总部首席财务官的邮件,对方称要进行「机密交易」。

虽说该员工最初依然抱有警惕性,但经不住对方多次邮件的轰炸和软磨硬泡麻醉,最终他还是答应和对方进行视频电话。

这时候骗局进入下一环节,该员工在视频电话里看到所谓的首席财务官,甚至还看到了其他几个相识的财务职员。

首席财务官要求该员工尽快转账,随后便中断视频电话,该员工已经完全相信了这场「机密交易」。

So,他前后 15 次分别向 5 个香港本地账户转账合计 2 亿港元。

直到骗局发生几天后,该员工觉得不太对劲,在向英国总部求证后,他才发现自己上当受骗了。

据香港警方介绍,骗子通过公司在 YouTube 和其他公开渠道的媒体素材,合成伪造英国总部首席财务官的外貌和声音。

接着利用 Deepfake(深度伪造)技术,为其他出席视频通话的其他人换上高管和同事的外貌及声音,也就是我们常说的「AI 换脸」。

而且会议主要是上级向下级下达转账命令的形式,事实上整个视频通话他就只做了一次自我介绍就闭麦了,没有机会和其他脸熟的员工交流。

目前香港警方表示,这个案件还在进一步调查 ing,现在还没有逮捕任何嫌疑人。

警方之所以要在案件告破前率先把案情公布,是想提醒更多公司和个人,避免这类 AI 骗局再次得逞。

图源:yahoo!新闻 @鉅亨網新聞中心

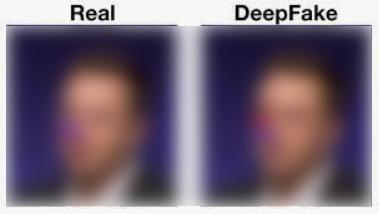

So,Deepfake 技术真有那么神奇?人一换上别人的「脸」真的很难分辨吗?

喏,所谓的 Deepfake,其实是 Deep learning 深度学习和 Fake(伪造)的合成词。

中文译为「深度伪造」,指使用深度学习技术生成合成图片、视频或音频的技术。

图源:网络

Deepfake 技术最常见、也是我们最熟知的应用,就是用来进行「AI 换脸」。

一开始是采用基于图形学的3D 模型重建追踪技术,后面又加入了深度学习技术。

如今为了减少深度学习的训练难度和提升生成质量,又加入了生成对抗网络技术。

这些名词要意义解释起来,小雷写一篇文章肯定是不够的,咱们就往简单了说嗷。

小伙伴可以这么理解:Deepfake 模型通过大量面部图像数据的训练,就可以学习到人脸特征之间的隐藏关系,从而生成和真实人脸特征十分相似的虚假人脸。

而且嚯,换脸技术通常伴随着声音伪造技术一起使用,俩 Buff 叠加能达到更加逼真的效果。

结合今天说的这个 AI 诈骗案,将视频分成数量足够多的图片,再将图片中的人脸替换,就可以得到另一张人脸的视频。

So,这个案件中其实除了被骗员工外,视频通话中出席的其他人都是利用 Deepfake 套上「假脸」的诈骗团伙成员。

目前,Deepfake 技术主要应用在影视制作、虚拟游戏等领域,这些还是比较正面的应用。

都说「科技是把双刃剑」,Deepfake 技术也逃不过这个定律。

emmm,目前 Deepfake 还被用于伪造名人、明星以及素人的不雅视频。

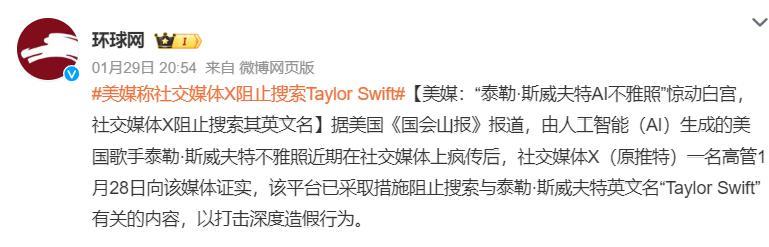

比如上个月,由 AI 生成的美国流行歌星泰勒 · 斯威夫特不雅照,就在网上广为流传。

这事儿甚至还让 X 平台采取紧急措施。

平台应阻止用户搜索和泰勒 · 斯威夫特英文名「Taylor Swift」的相关内容,以打击 Deepfake 行为。

图源:微博 @环球网

问题又来了,Deepfake 效果这么以假乱真,普通人难道只有上当受骗的份吗?

非也非也,从上面说到的 Deepfake 原理出发,小雷给大伙总结了几招实用小技巧。

首先「AI 换脸」想要效果逼真的,Deepfake 必须经过大量的人脸图像数据来训练。

而大多数人像训练模型需要寻找人脸上足够多的对齐点支持,才能正确对齐换脸。

So,我们普通人一来并没有那么多的公开照片,二来照片绝大多数又是正面拍的。

这时只要让 AI 换脸的人侧面,脸上对齐点变少 侧脸数据训练不足就非常容易露馅。

还有一招,在视频通话时要求对方用手在脸上来回晃动。

如果是 AI 换脸的人脸,因为手和人脸图像重叠,可能会导致 Deepfake 实现出现混乱。

而且手在面前摆动,也会让伪造的人脸出现覆盖延迟,这样的纰漏我们一眼就能看出来。

总之,AI 技术的出现确实是件好事。

但随之带来的诸如 Deepfake 技术被滥用等问题,也是一件令人十分头疼的事了。

小雷希望有关组织或部门,能够尽快制定出台相应的管理政策,让 AI 重回正轨吧。

封面图源:CNBC 网